La estrategia de inteligencia artificial de código abierto de Meta explicada

Mark Zuckerberg explica los pilares de su estrategia IA de código abierto, y por qué es buena para desarrolladores, Meta y la sociedad.

De entre todas las Big Tech, Meta es la que está teniendo una estrategia más diferenciada en relación a la Inteligencia Artificial, habiendo apostado por ser los abanderados de la inteligencia artificial de código abierto.

¿Por qué hace esto Meta? Llevaba tiempo queriendo hacer una entrada ahondando en las razones estratégicas detrás de este movimiento, a mi juicio, muy acertado. El propio Mark Zuckerberg se me ha adelantado desgranando su estrategia en un post: Open Source AI is the Path Forward.

Es un post interesantísimo, que habla del código abierto, pero también de los incentivos que han llevado a Meta a gastar cientos de millones entrenando a sus modelos para después compartirlos.

Llegaría a decir que es una lectura obligatoria para cualquiera que trabaje en tecnología y/o pueda estar interesado por la IA. Y, para poner las cosas más fáciles, he dedicado unas horas a traducirlo, y añadido un comentario final después con mi opinión. ¡Disfrutadlo!

En los primeros días de la computación de alto rendimiento, las principales empresas tecnológicas de la época invirtieron considerablemente en desarrollar sus propias versiones propietarias de Unix. En aquellos tiempos, era difícil imaginar que cualquier otro enfoque pudiera producir un software tan avanzado. Sin embargo, con el tiempo, Linux, de código abierto, ganó popularidad. Inicialmente porque permitía a los desarrolladores modificar su código como quisieran y también era más asequible. Más adelante, porque se volvió más avanzado, más seguro y tenía un ecosistema más amplio que soportaba más capacidades que cualquier Unix cerrado. Hoy en día, Linux es el estándar de la industria tanto para la computación en la nube como para los sistemas operativos que ejecutan la mayoría de los dispositivos móviles, y todos nos beneficiamos de productos superiores gracias a ello.

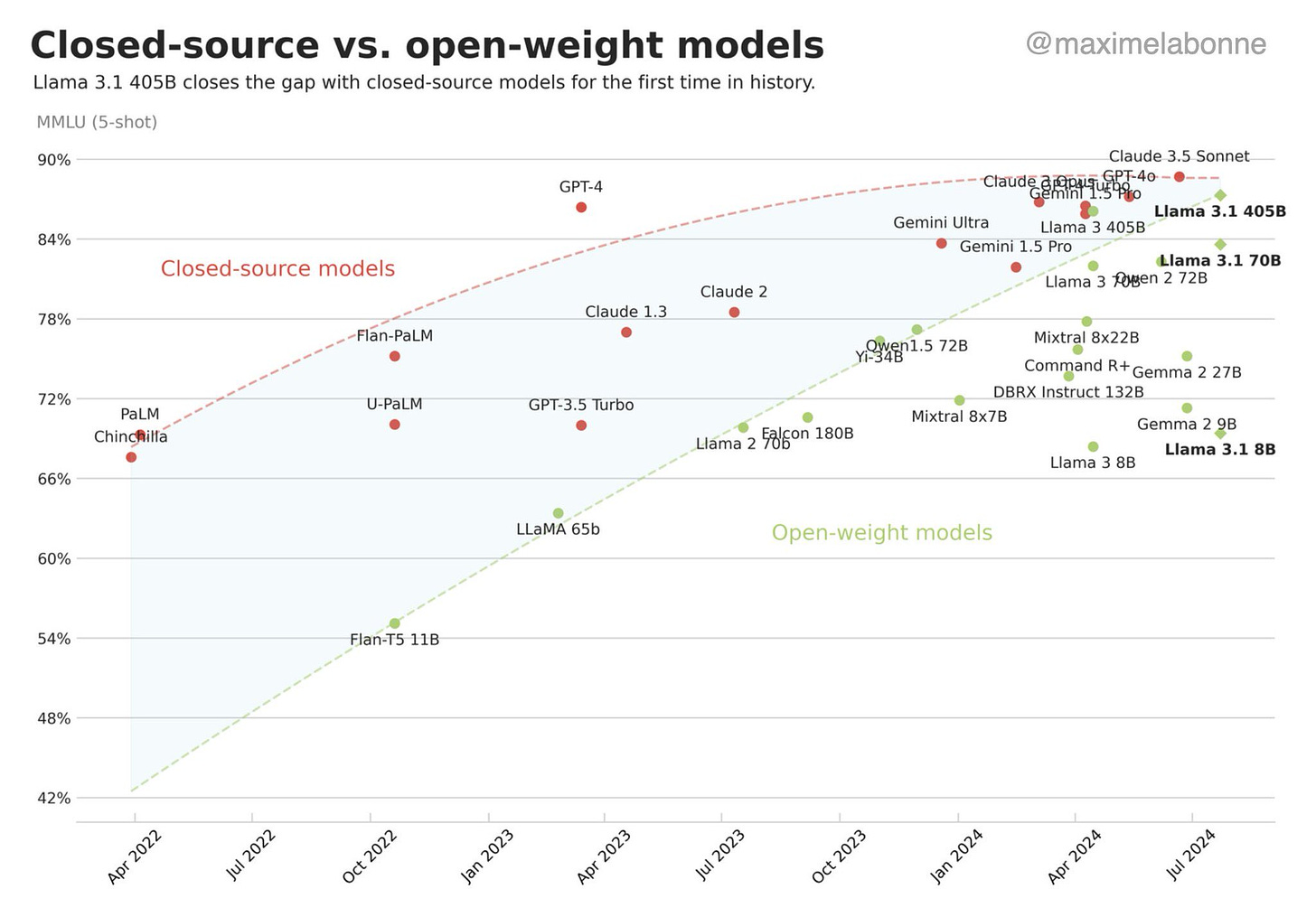

Creo que la inteligencia artificial se desarrollará de una manera similar. Hoy en día, varias empresas tecnológicas están creando modelos propietarios de vanguardia. Pero el código abierto está cerrando rápidamente la brecha. El año pasado, Llama 2 sólo era comparable a la generación anterior a los modelos en la frontera. Este año, Llama 3 es competitivo con los modelos más avanzados e incluso lidera en algunas áreas. A partir del próximo, esperamos que los futuros modelos de Llama se conviertan en los más avanzados de la industria. Pero incluso antes de eso, Llama ya está liderando en términos de apertura, modificabilidad y eficiencia en costes.

Hoy estamos dando los siguientes pasos para que la inteligencia artificial de código abierto se convierta en el estándar de la industria. Estamos lanzando Llama 3.1 405B, el primer modelo de inteligencia artificial de código abierto con un nivel similar al de otros modelos en la frontera, así como los nuevos y mejorados modelos Llama 3.1 70B y 8B. Además de tener un coste/rendimiento significativamente mejor en comparación con los modelos cerrados, el hecho de que el modelo 405B sea abierto lo convierte en la mejor opción para ajustar y refinar modelos más pequeños.

Además de lanzar estos modelos, también estamos trabajando con distintas empresas para hacer crecer el ecosistema. Amazon, Databricks y NVIDIA están lanzando gamas completas de servicios para apoyar a los desarrolladores en el ajuste y refinación de sus propios modelos. Innovadores como Groq, han construido servicios de inferencia de baja latencia y coste. Los modelos de Meta estarán disponibles en todas las principales nubes, incluyendo AWS, Azure, Google, Oracle y más. Empresas como Scale.AI, Dell, Deloitte y otras están listas para ayudar a las empresas a adoptar Llama y entrenar modelos personalizados con sus propios datos. A medida que la comunidad crece y más empresas desarrollan nuevos servicios, colectivamente podemos hacer de Llama el estándar de la industria y llevar a todos los beneficios de la inteligencia artificial.

Meta está comprometida con la inteligencia artificial de código abierto. A continuación explicaré por qué creo que el código abierto es la mejor plataforma de desarrollo para ti, por qué abrir el código de Llama es bueno para Meta y por qué la inteligencia artificial de código abierto es buena para el mundo, convirtiéndola así en una plataforma sostenible a largo plazo.

Por qué la IA de código abierto es buena para los desarrolladores

Cuando hablo con desarrolladores, CEOs y funcionarios gubernamentales de todo el mundo, normalmente escucho varios temas recurrentes:

Necesitamos entrenar, ajustar y refinar nuestros propios modelos. Cada organización tiene diferentes necesidades que se satisfacen mejor con modelos de distintos tamaños entrenados o ajustados con sus datos específicos. Las tareas en el dispositivo y las tareas de clasificación requieren modelos pequeños, mientras que las tareas más complicadas requieren modelos más grandes. Ahora podrás tomar los modelos Llama más avanzados, entrenarlos con tus propios datos y luego refinarlos hasta un modelo de tu tamaño óptimo, sin que nosotros ni nadie vea tus datos.

Necesitamos controlar nuestro propio destino y no quedar atados a un proveedor cerrado. Muchas organizaciones no quieren depender de modelos que no pueden ejecutar y controlar por sí mismas. No quieren que los proveedores de modelos propietarios puedan cambiarlos, alterar sus términos de uso o incluso dejar de darles servicio por completo. Tampoco quieren quedar atados a una sola nube que tenga derechos exclusivos sobre un modelo. El código abierto habilita que puedas moverte fácilmente entre un amplio ecosistema de empresas, gracias a un conjunto de herramientas interoperables.

Necesitamos proteger nuestros datos. Muchas organizaciones manejan datos sensibles que necesitan asegurar y no pueden enviar a modelos cerrados a través de APIs en la nube. Otras organizaciones simplemente no confían en los proveedores de modelos propietarios. El código abierto aborda estos problemas permitiéndote ejecutar los modelos donde quieras. Es bien aceptado que el software de código abierto tiende a ser más seguro porque se desarrolla de manera más transparente.

Necesitamos un modelo que sea eficiente y asequible de ejecutar. Los desarrolladores pueden ejecutar inferencias en Llama 3.1 405B en su propia infraestructura aproximadamente a un 50% del coste de usar modelos cerrados como GPT-4o. Tanto para tareas de inferencia orientadas al usuario como para tareas de inferencia offline.

Queremos invertir en el ecosistema que será el estándar a largo plazo. Muchas personas ven que el código abierto está avanzando a un ritmo más rápido que los modelos cerrados, y quieren construir sus sistemas sobre la arquitectura que les dará la mayor ventaja a largo plazo.

Por qué la IA de código abierto es buena para Meta

El modelo de negocio de Meta se basa en crear las mejores experiencias y servicios para las personas. Para lograrlo, debemos asegurarnos de tener siempre acceso a la mejor tecnología y no estar atrapados en el ecosistema cerrado de un competidor donde puedan restringir lo que construimos.

Una de mis experiencias formativas ha sido construir nuestros servicios limitados por lo que Apple nos permite construir en sus plataformas. Entre la comisión que cobran a los desarrolladores, las reglas que aplican arbitrariamente y el bloqueo constante de innovaciones de producto, resulta evidente que Meta y muchas otras compañías podríamos construir servicios mucho mejores si nuestros competidores no pudieran restringir lo que podemos lanzar al mercado. A nivel filosófico, esta es una razón importante por la que creo tan firmemente en construir ecosistemas abiertos en IA y AR/VR para los nuevos entornos de computación.

A menudo me preguntan si me preocupa perder la ventaja tecnológica por hacer Llama de código abierto, pero creo que esta forma de pensar pasa por alto la visión global por algunas razones:

Primero, para asegurarnos de tener acceso a la mejor tecnología y no estar atrapados en un ecosistema cerrado a largo plazo, Llama necesita desarrollarse en un ecosistema completo de herramientas, mejoras de eficiencia, optimizaciones de silicio y otras integraciones. Si fuéramos la única empresa que utiliza Llama, este ecosistema no se desarrollaría y no nos iría mejor que las variantes propietarias de Unix.

Segundo, espero que el desarrollo de la IA siga siendo muy competitivo, lo que significa que hacer de código abierto cualquier modelo no implicará ceder una ventaja significativa sobre los siguientes mejores modelos en ese momento. El camino para que Llama se convierta en el estándar de la industria es siendo consistentemente competitivo, eficiente y abierto, generación tras generación.

Tercero, una diferencia clave entre Meta y los proveedores de modelos propietarios es que nuestro negocio no consiste en vender acceso a modelos IA. Por lo tanto, liberar Llama no socava nuestros ingresos, sostenibilidad o capacidad para invertir en investigación como sí lo hace para los proveedores cerrados. (Esta es una razón por la que algunos de estos proveedores presionan constantemente a los gobiernos en contra del código abierto.)

Finalmente, Meta tiene una larga historia de proyectos exitosos de código abierto. Hemos ahorrado miles de millones de dólares al haber liberado nuestros diseños de servidores, redes y centros de datos con el Open Compute Project y hacer que las cadenas de suministro se estandarizasen sobre nuestros diseños. Nos beneficiamos de las innovaciones que aporta el ecosistema al liberar herramientas líderes como PyTorch, React y otras. Este enfoque ha funcionado consistentemente para nosotros cuando lo hemos mantenido en el largo plazo.

Por qué la IA de código abierto es buena para el mundo

Creo que el código abierto es necesario para un futuro donde la IA tenga un impacto positivo. La IA tiene más potencial que cualquier otra tecnología moderna para aumentar la productividad, la creatividad y la calidad de vida humana, y para acelerar el crecimiento económico al tiempo que desbloquea el progreso en la investigación médica y científica. El código abierto garantizará que más personas en todo el mundo tengan acceso a los beneficios y oportunidades de la IA, que el poder no se concentre en manos de un pequeño número de empresas, y que la tecnología pueda desplegarse de manera más equitativa y segura en la sociedad.

Existe un debate en curso sobre la seguridad de los modelos de IA de código abierto, y mi opinión es que la IA de código abierto será más segura que las alternativas. Creo que los gobiernos concluirán que es de su interés apoyar el código abierto porque hará que el mundo sea más próspero y seguro.

Mi marco para entender la seguridad es que necesitamos protegernos contra dos categorías de daño: el no intencional y el intencional. El no intencional se da cuando un sistema de IA puede causar daño incluso cuando no era la intención de quienes lo manejan hacerlo. Por ejemplo, los modelos modernos de IA pueden dar, sin saberlo, malos consejos de salud. En escenarios más futuristas, algunos se preocupan de que los modelos puedan replicarse a sí mismos de manera no intencional o hiperoptimizar objetivos en detrimento de la humanidad. El daño intencional es cuando un actor malintencionado usa un modelo de IA con el objetivo de causar daño.

Vale la pena señalar que el daño no intencional cubre la mayoría de las preocupaciones que la gente tiene sobre la IA, que van desde la influencia que los sistemas de IA tendrán en los miles de millones de personas que los usarán, hasta la mayoría de los escenarios de ciencia ficción verdaderamente catastróficos para la humanidad. En este sentido, el código abierto debería ser significativamente más seguro ya que los sistemas son más transparentes y pueden ser ampliamente escrutados. Históricamente, el software de código abierto ha sido más seguro por esta razón. Del mismo modo, usar Llama con sus sistemas de seguridad como Llama Guard probablemente será más seguro que los modelos cerrados. Por esta razón, la mayoría de las conversaciones sobre la seguridad de la IA de código abierto se centran en el daño intencional.

Nuestro proceso de seguridad en este sentido incluye pruebas rigurosas y red-teaming para evaluar si nuestros modelos son capaces de causar daño significativo, con el objetivo de mitigar los riesgos antes del lanzamiento. Dado que los modelos son abiertos, cualquiera puede también evaluarlos por sí mismo. Debemos tener en cuenta que estos modelos se entrenan con información que ya está en internet, por lo que el punto de partida al considerar el daño debe ser si un modelo puede facilitar más daño que la información que se puede recuperar rápidamente de Google u otros resultados de búsqueda.

Al razonar sobre el daño intencional, es útil distinguir entre lo que los actores individuales o a pequeña escala pueden ser capaces de hacer en comparación con lo que los actores a gran escala, como los estados nacionales con vastos recursos, puedan llegar a hacer.

En algún momento en el futuro, actores malintencionados individuales podrán usar la inteligencia de los modelos de IA para causar nuevos daños a partir de la información disponible en internet. En este punto, el equilibrio de poder será crítico para la seguridad de la IA. Opino que será mejor vivir en un mundo donde la IA esté ampliamente desplegada para que actores más grandes puedan controlar el poder de los actores malintencionados más pequeños. Así es como hemos gestionado la seguridad en nuestras redes sociales: nuestros sistemas de IA más robustos identifican y detienen las amenazas de actores menos sofisticados que a menudo usan sistemas de IA a menor escala. De manera más amplia, las instituciones más grandes que implementan IA a gran escala promoverán la seguridad y la estabilidad en toda la sociedad. Siempre que todos tengan acceso a generaciones similares de modelos, lo que el código abierto promueve, los gobiernos e instituciones con más recursos de cómputo podrán controlar a aquellos actores malintencionados con menos recursos.

La siguiente pregunta es cómo deben manejar los EE.UU. y las naciones democráticas la amenaza de estados con recursos masivos como China. La ventaja de Estados Unidos es la innovación descentralizada y abierta. Algunas personas argumentan que debemos cerrar nuestros modelos para evitar que China tenga acceso a ellos, pero mi opinión es que esto no funcionará y solo perjudicará a los EE.UU. y sus aliados. Nuestros adversarios son excelentes en espionaje, robar modelos que caben en una memoria USB es relativamente fácil, y la mayoría de las empresas tecnológicas están lejos de operar de una manera que haría esto más difícil. Parece probable que, un planeta en el que sólo existieran modelos cerrados, resultase en un pequeño número de grandes empresas y nuestros adversarios geopolíticos teniendo acceso a los modelos de vanguardia, mientras startups, universidades y pequeñas empresas no tendrían esa oportunidad. Además, restringir la innovación estadounidense al desarrollo de código cerrado aumenta la posibilidad de que no lideremos en absoluto. En cambio, creo que nuestra mejor estrategia es construir un ecosistema abierto robusto y hacer que nuestras empresas líderes trabajen estrechamente con nuestro gobierno y aliados para asegurarse de que puedan aprovechar al máximo los últimos avances, logrando así una ventaja sostenible a largo plazo.

Cuando consideres las oportunidades futuras, recuerda que la mayoría de las empresas tecnológicas líderes y la investigación científica de hoy en día se basan en software de código abierto. La próxima generación de empresas e investigaciones utilizará IA de código abierto si invertimos colectivamente en ella. Eso incluye a las startups que recién comienzan, así como a las personas en universidades y países que pueden no tener los recursos para desarrollar su propia IA de última generación desde cero.

En resumen, la IA de código abierto representa la mejor oportunidad para el planeta de aprovechar esta tecnología y crear la mayor oportunidad económica y seguridad para todos.

Construyamos esto juntos

Con modelos anteriores de Llama, primero Meta los desarrolló internamente y luego los publicó, pero no se enfocó mucho en construir un ecosistema más amplio. Estamos adoptando un enfoque diferente con este lanzamiento. Estamos formando equipos internamente para permitir que tantos desarrolladores y partners como sea posible usen Llama, y estamos construyendo activamente relaciones para que más empresas en el ecosistema también puedan ofrecer funcionalidades únicas a sus clientes.

Creo que el lanzamiento de Llama 3.1 será un punto de inflexión en la industria donde la mayoría de los desarrolladores comenzarán a usar principalmente código abierto, y espero que este enfoque solo crezca a partir de aquí. Espero que te unas a nosotros en este viaje para llevar los beneficios de la IA a todos en el mundo.

Puedes acceder a los modelos ahora en llama.meta.com.

💪,

MZ

El comentario

Es difícil ponerle un pero al post de Zuckerberg porque lo explica todo con gran claridad:

Meta necesita un LLM y no quiere depender de terceros

Tiene los recursos para crearlo y, poniéndolo a disposición de la comunidad puede convertirlo en el estándar, lo que sin duda le traerá beneficios indirectos

Hay grandes motivos por los que la industria y los gobiernos prefieran modelos abiertos a cerrados, generando un ciclo de retroalimentación hacia soluciones de este tipo

A Meta, que vive de que otros generen contenido en sus plataformas, le interesa que los creadores tengan cuántas más alternativas mejor

También es importante lo que no dice en el artículo. Cómo por ejemplo, que:

Meta tiene uso para sus GPUs más allá de entrenar modelos de IA generativa. De hecho, su principal uso es la generación de feeds y su sistema de publicidad del cuál provienen el 99% de sus ingresos. Eso hace que entrenar Llama se convierta en algo mucho más asequible que para quienes no tienen usos secundarios para su infra como OpenAI o Anthropic.

El movimiento hacia el código libre es una magnífica herramienta de captación y retención para investigadores, el verdadero recurso escaso en la era de la IA. Estos, no sólo se aseguran así de que sus avances sean publicados a la comunidad, si no que además, suman el acceso a la potencia de cálculo de Meta, algo que muy pocas empresas pueden ofrecer.

Por otra parte, si Llama termina siendo el estándar con el que los programadores se acaban introduciendo en el mundo de la IA, eso también le proporciona a Meta un pipeline excelente para fichar ingenieros.

Por último, y no menos importante, este movimiento también hace daño a sus rivales, comoditizando una tecnología que para otros como OpenAI es su único modelo de negocio y, para otros, otra potencial fuente de ingresos como Gemini sobre la nube de Google.

En definitiva, la estrategia de código abierto de Meta en relación a la IA me parece muy bien tirada. La única duda al respecto es si las soluciones propietarias podrán mantener la ventaja frente al código abierto, pero la realidad es que la tendencia es justamente la inversa, cómo podemos apreciar en las pendientes de la siguiente gráfica:

La verdad, es un gusto observar cuando la mejor estrategia es compartir. ¡Larga vida al código libre!

Excelente publicación y edición, muchas gracias por compartirla. He aprendido demasiado con todo esta info. 👏👏👏👏👏

Buenísima edición 👌🏼